认识 AI

认识 AI

人工智能(Artificial Intelligence,AI)是计算机科学的一个分支,是让机器模拟人类智能的技术,使其能像人一样学习、推理、感知和决策。例如,它能识别语音、推荐视频或汽车的自动驾驶等。

AI 之所以智能,是因为它底层是基于 Transformer 架构实现的,Transformer 是 AI 处理语言的核心架构(ChatGPT 、Deepseek 都是基于它实现)。它的核心突破是“自注意力机制”,让 AI 能像人一样,通过上下文理解每个词的含义。例如:

举例:“她吃了一个苹果”

● 传统模型只能逐字分析,可能忽略“吃”和“苹果”之间的关联。

● Transformer会自动让“吃”关注“苹果”,理解动作和对象的关系。

● Transformer让AI学会“联系上下文”,像人类一样理解语言逻辑,是当前AI爆发(如ChatGPT)的核心技术。

大模型原理

大模型 = 通过海量数据训练出来的“超级自动补全工具”,核心能力是根据输入内容预测下一个词。

核心原理拆解

- 底层架构:Transformer(积木块结构)

- 核心组件:自注意力机制(Self-Attention)

- 作用:让模型像人类一样,自动关注输入内容中哪些词更重要(例如:“她吃了一个苹果”中,“吃”是核心动词)。

训练过程

- 预训练:用全网文本(书籍/网页等)学习语言规律,建立知识库。例如:输入 天空是___ , 模型学习预测是 蓝色。

- 微调: 用特定的任务数据(如对话/问答)调整模型,让它更听话。

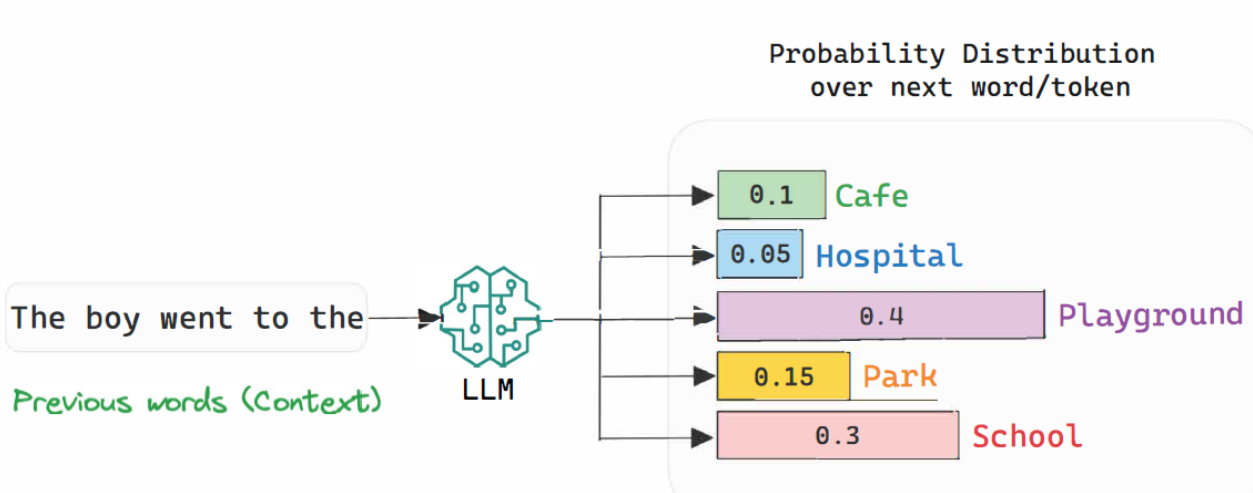

运行本质: 概率

- 每次输出一个词时,模型计算所有可能词的概率,选择最高概率的词(或者随机选高概率词增加多样性)。

- 例:输入“The boy went to the”,模型可能输出“Cafe”(概率0.1)、“Hospital”(0.05)、“Playground”(0.4)、“Park”(0.15)、“School”(0.3)。

- 大模型输出时,会选择概率值最高的词,最终会输出:The boy went to the Playground(男孩去了游乐场)

- 这里的概率,是指条件概率,也就是说,【游乐场】是【男孩去的地方】概率0.4

提示

大模型正是因为依据概率回答,所以会存在“AI幻觉”,也就是所谓的“胡说八道”。所以,对于大模型生成的数据,需要进行优化数据、加入人工审核、提醒用户自行验证等。

人工智能的发展历程

早期阶段(1950s-1970s)

- 1950年:图灵测试提出

- 1956年:达特茅斯会议,人工智能概念正式确立

- 1960s:专家系统出现

知识工程时代(1980s)

- 基于规则的专家系统兴起

- 知识表示和推理技术发展

机器学习时代(1990s-2000s)

- 统计学习方法兴起

- 支持向量机、决策树等算法发展

深度学习时代(2010s至今)

- 神经网络技术复兴

- 大数据和强大计算能力推动发展

- 大语言模型诞生

人工智能的主要分支

机器学习

让计算机通过数据学习规律和模式,包括监督学习、无监督学习、强化学习等。

自然语言处理(NLP)

使计算机能够理解、解释、生成人类语言的技术。

计算机视觉

让计算机能够"看懂"图像和视频内容的技术。

语音识别与合成

实现计算机与人类通过语音交互的技术。

大语言模型简介

大语言模型(Large Language Models,LLMs)是近年来人工智能领域的重要突破,它们通过在海量文本上进行训练,能够理解和生成高质量的人类语言。

理解人工智能的基本概念和发展历程,是学习和应用 Spring AI 的重要基础。